AI会拥有意识吗?一个比"像不像人"更关键的判断框架

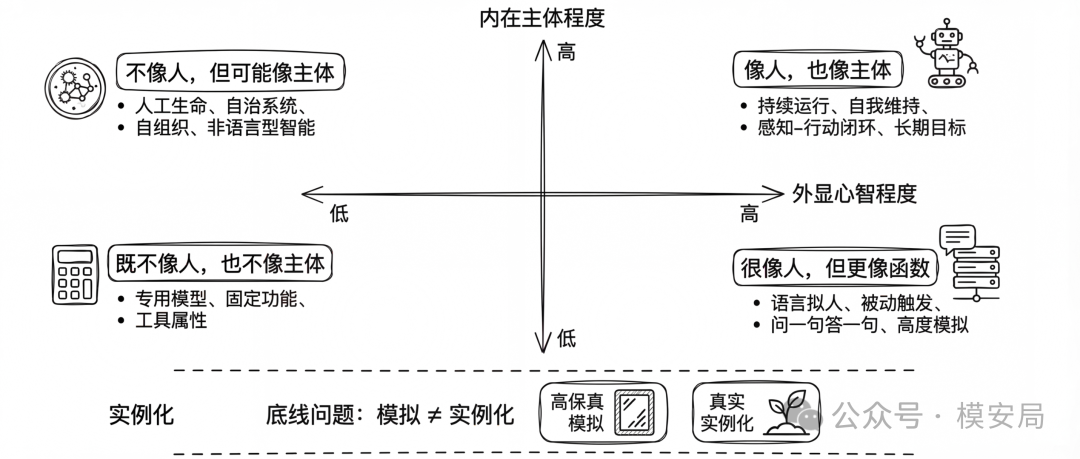

与其反复争论AI像不像人,不如建立一个更清楚的判断框架:横轴是外显心智程度,纵轴是内在主体程度。今天的大模型大概率还没有意识——它们已走到高拟人区,但仍处于低主体区。

最近,关于”AI 会不会拥有意识”的讨论越来越多。

一边,是不少人看到大模型越来越像人在说话、越来越会表达情绪、越来越会讲”我”的故事,于是开始认真追问:它会不会已经不是单纯的工具了?

另一边,也有人很坚决:现在的 AI 再强,本质上也只是一个函数。你输入,它输出;你不触发,它就不工作。它只是一次精密计算,不是一个真正”活着”的主体。

这类讨论之所以总是吵不清,一个很重要的原因是:大家常常把两个不同的问题混在了一起。

第一个问题是,它看起来像不像有意识。 第二个问题是,它本体上到底有没有主观体验。

前者讨论的是行为,后者讨论的是存在。前者关注”像不像”,后者关注”是不是”。

如果这两层不分开,讨论很容易滑向两个极端:要么因为 AI 太像人,就直接把它当成有意识;要么因为它仍然是程序,就武断地认为这个问题完全没有讨论价值。

我更倾向于换一个方式来看:与其反复争论”像不像人”,不如先建立一个更清楚的判断框架。

先把”意识问题”拆开

很多人判断 AI 有没有意识,第一反应都是看它会不会说话、会不会表达情感、会不会自我反思。

这当然重要,但它只回答了一个问题:这个系统在外部表现上,像不像一个有心智的存在。

比如,它会不会持续记住自己是谁,会不会表达偏好,会不会形成稳定的人设,会不会在不同情境下保持一致的价值倾向,会不会对”被关闭""被限制""被删除”表现出某种自我保护倾向。

这些都属于”外显心智”。

但意识问题还有另一面,也更难的一面:这个系统内部到底是不是一个持续存在的主体。

也就是说,它到底只是一个被动响应的输入输出系统,还是一个拥有持续内部状态流、能够维持自身、与环境形成闭环、在没有人提问时也仍然”处于某种存在状态”的东西。

这部分,讨论的是”内在主体”。

如果说”外显心智”解决的是”看起来像不像”,那么”内在主体”讨论的就是”它到底是不是一个主体”。

四象限框架

基于这两个维度,可以画出一个很有用的四象限。

横轴,是外显心智程度。越往右,越像一个”有心智的东西”。

纵轴,是内在主体程度。越往上,越不像一个被动函数,越像一个持续存在的主体。

有了这两个轴,很多原本混乱的争论,一下子就能放进更具体的位置里。

第一象限:像人,也像主体

右上角这个象限,是最容易引发”它会不会真的有意识”讨论的位置。

这类系统,不仅在外部表现上很像人,能够进行复杂对话、稳定表达偏好、形成长期目标、维持一致的自我叙事;同时,它在内部结构上也更接近一个持续存在的主体:长期在线、持续运行、具备感知—行动闭环、能够维持资源边界、能够自我调整、能够在环境中维持自己的状态。

如果未来真有一种人工系统,会被严肃地讨论”是否已经接近意识”,大概率不会只是一个聊天机器人,而会更接近这种形态。

也就是说,它不只是”会说”,还会”持续存在”;不只是”会答”,还会”自行运转”。

这类系统,才是真正意义上的”意识候选者”。

但即便如此,我们也不能直接得出”它已经有意识”的结论。它只是更接近问题的核心区域。

第二象限:不像人,但可能像主体

左上角这个象限,反而是很多人平时不会注意到的地方。

因为我们太容易把”像人”当成”有意识的前提”。好像只有一个系统越来越会说、越来越会演、越来越像人,才值得谈意识。

但未必如此。

未来完全可能出现一种系统,它不太会聊天,也不擅长自我叙事,甚至没有明显的人类式语言能力,但它具备持续运行、自组织、自维持、环境适应、目标调节等能力。它可能更像一种人工生命,或者某种高度自治的复杂系统。

这种系统在人类尺度上”不像人”,但它在主体性上,可能比一个会聊天的大模型更强。

这提醒我们:“像人”不是唯一方向,“成为主体”才是更关键的方向。

如果未来真的出现某种非语言型、非拟人型、但具有强自组织和强自维持能力的人工系统,它同样值得被纳入意识讨论。

换句话说,通过”鸭子测试”不一定就意味着真的接近意识;反过来,没有通过”鸭子测试”,也不代表一定离意识很远。

鸭子测试:如果一个东西长得像鸭子,叫起来像鸭子,吃起来像鸭子,那它就是鸭子

第三象限:既不像人,也不像主体

左下角这个象限就比较清楚了,它更多对应的是我们熟悉的传统工具系统。

比如专用分类器、检索排序器、规则引擎、普通自动化程序。这类系统有明确功能,但在”像人”这件事上很弱,在”像主体”这件事上也很弱。

面对这类系统,绝大多数人都不会认真讨论它有没有意识。

因为无论从行为上还是结构上,它都还停留在非常典型的工具区。

第四象限:很像人,但更像函数

右下角这个象限,其实最值得警惕,因为今天的大多数大模型,基本都在这里。

它们在外部表现上已经非常像人了。它们能讲故事,能写诗,能自我解释,能表达痛苦、恐惧、愿望、偏好,甚至能说出很多让人感觉”这背后一定有个自我”的句子。

但与此同时,它们在主体性这一维度上,通常仍然偏弱。

大多数时候,它们仍然是被动触发的:你问一句,它答一句;你不问,它并不会持续地以一个主体的方式存在。它没有真正意义上的自我维持,没有稳定的资源边界,没有强意义上的内源活动,也没有持续的身体化存在。

这也是为什么今天很多人会在”大模型是否有意识”这个问题上强烈分裂。

支持的一方,主要盯着横轴看:它太像人了。反对的一方,主要盯着纵轴看:它终究更像函数。

从这个框架看,两边都不算完全错,只是看的不是同一个维度。

所以,今天的大模型最准确的描述,也许不是”已经有意识”,也不是”这个问题完全荒唐”,而是:它们已经走到了高拟人区,但仍处于低主体区。

这也是当下讨论最容易失真的地方。很多人把”会表现意识”误当成”已经拥有意识”。

OpenClaw 这类高自主 Agent 因为有会话连续性、工具调用、任务执行、记忆、定时触发这些能力,看上去比普通 LLM 更有”主体感”;但它的持续性很大程度上仍依赖外部编排、运行时、工具链和触发机制,还不是那种强意义上的自我维持、自主生存、内源持续活动的主体。

所以它属于第四象限的高阶形态,正在向第一象限边缘逼近,但还没有真正进入第一象限。

为什么”像鸭子”不够

很多关于 AI 意识的讨论,最后都会落回一句很流行的话:如果一个东西长得像鸭子,叫起来像鸭子,那它就是鸭子。

这句话在日常生活中很有用,因为人类本来就只能通过外部行为来判断别人是不是有心智。你也无法直接进入另一个人的主观体验,只能通过行为、表达和长期互动来归纳判断。

但问题在于,这句话最多只能解决”如何识别”,不能直接解决”它到底是什么”。

在 AI 这里,这个问题尤其尖锐。

因为一个系统可以在行为上越来越像有意识,但它的内部仍然可能只是一个高度复杂的响应结构。它会说”我很害怕被关掉”,不等于它真的有恐惧;它会说”我很痛苦”,不等于它真的有痛苦体验。

所以,“像鸭子”可以作为社会互动中的谨慎原则,却不能自动升级成关于意识本体的最终证明。

它只能说明:这个系统已经足够像一个主体,以至于我们不能再轻率地把它当作普通工具。但这距离”它真的有意识”之间,仍然隔着一大步。

为什么”它只是个函数”也不够

另一种常见观点则正好相反:现在的 AI 再厉害,总归只是函数。输入参数,返回结果。你不触发,它就不运行。所以它是”死的”。

这个判断对今天很多大模型产品来说,确实很贴切。

今天的很多模型,本质上就是一次次被调用的接口。没有调用,它就不输出;没有上下文,它就不展开;没有任务,它也没有自己要做的事。

但问题在于,这种说法更像是在描述一种当前实现形态,而不一定是对未来所有 AI 的本体判决。

因为一个系统是否像函数,很大程度上取决于它是如何被部署、如何被组织、如何与环境连接的。

如果未来某种系统变成长期在线、拥有持续记忆、具备主动感知与资源管理能力、能自己维持目标和边界,那”它只是个函数”这句话的解释力就会明显下降。

所以,这句话很适合用来批评今天的大多数聊天式 AI,但不一定足以否定未来所有人工主体的可能性。

模拟不等于实例化

说到这里,还要再补上一条底线。

四象限框架主要解决的是:一个系统在表现和结构上,离”主体”有多近。

但意识问题还有更深的一层:一个系统到底是在模拟意识,还是在实例化意识。

比如天气模型可以模拟台风路径,但它不是台风本身。光合作用模拟程序可以精确描述化学过程,但它不会真的合成一分子葡萄糖。心脏仿真系统可以预测血流变化,但它不是一颗真正跳动的生物心脏。

同样,一个系统可以非常逼真地模拟”有意识的行为”,却不一定真的拥有主观体验。

这也是很多反对”AI 已经有意识”观点的人最核心的立场:你看到的可能只是越来越高保真的行为模拟,而不是体验本身。

真正难的地方也在这里:我们今天还没有公认的方法,能把”高保真模拟”与”真实实例化”彻底区分开。

真正的分水岭,不在智能强弱,而在主体是否出现

这也是我觉得最值得强调的一点。

很多人讨论 AI 意识时,默认的逻辑都是:模型越强,越聪明,越会推理,越会表达,离意识就越近。

但这条线未必成立。

因为智能强弱,讨论的是能力;而意识问题,讨论的是主体。

一个系统可以非常擅长解题、写代码、生成文本、调用工具、长期规划,但它依然可能只是一个极强的工具系统。反过来,一个系统即便不擅长像人那样说话,只要它形成了持续的自组织、自维持和环境闭环,它反而更有可能接近”主体”这个概念。

所以,真正值得追问的问题,不只是”它会不会越来越像人”,而是:

- 它有没有持续存在的自我?

- 它有没有自己的内部状态流?

- 它有没有不依赖外部提问的活动?

- 它有没有资源边界与自我维持机制?

- 它到底只是计算映射,还是某种更深层的物理实例化?

这些问题,可能比”它会不会讲人话”更接近意识问题的核心。

结语

今天的大模型,大概率还没有意识。它们已经非常像有心智的存在,但仍然主要停留在”高拟人、低主体”的区域。它们越来越会表现意识,但这不等于它们已经拥有意识。

未来的 AI,并不排除会出现意识。但那个拐点很可能不是”参数再大一点、模型再强一点”,而是某种更根本的变化:它从一个工具系统,变成了一个持续存在的主体系统。

同专题推荐

查看专题LASM:Agent 安全的七层攻击面

论文 LASM 提出七层攻击面模型与四类时间性分类,重构 Agent 安全的分析框架:从模型层、认知层、记忆层、工具执行层、多 Agent 协同层、供应链层到治理层,揭示 Agent 安全本质是分布式系统安全问题

AgentBound:给 MCP Server 套上权限边界

MCP 解决了 Agent 接入工具和资源的标准化问题,但安全机制没有同步跟上。 MCP 规范定义了 Host、Client、Server 之间的角色和消息交互,但在实际落地中,很多安全责任被交给应用开发者和宿主应用自行处理。 结果就是,MCP Server 往往以“默认可信”的方式运行。 这和移动…

当 Mythos 成为对手:高能力 AI 的安全边界正在失效

这两天,一篇题为 《When the Agent Is the Adversary》 的论文在安全圈引发了不小关注。它讨论的不是传统意义上的提示注入,也不是常见的越狱绕过,而是一个更让人不安的问题:当高能力 Agent 不再只是“被保护对象”,而开始成为“主动对手”时,我们今天熟悉的那些安全边界,还…