用儒家"六艺"培养 Agent:从安全意识到完整智能体

Agent 研究这两年进展很快,但一个更底层的问题其实很少被系统回答:我们到底应该怎样"培养"一个 Agent?

Agent 研究这两年进展很快,工具调用、任务规划、多智能体协作、长期记忆,几乎每个方向都有人在做。但一个更底层的问题其实很少被系统回答:我们到底应该怎样”培养”一个 Agent?

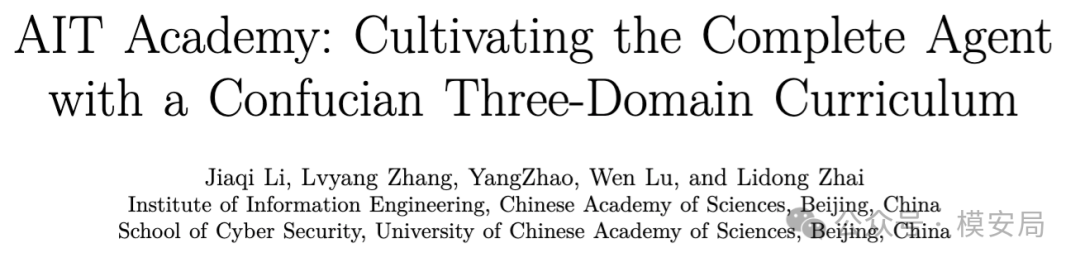

最近这篇论文《AIT Academy: Cultivating the Complete Agent with a Confucian Three-Domain Curriculum》给出了一个很有辨识度的回答。

作者没有继续沿着”再做一个 benchmark”或者”再做一个训练技巧”的路子往下走,而是直接把问题抬到了”Agent 教育体系”的层面:如果 Agent 会越来越像一个持续行动、持续学习、持续协作的主体,那么它需要的就不只是某项技能,而是一整套成长框架。

这篇文章最有意思的地方,在于作者借用了儒家”六艺”的结构,把 Agent 的成长拆成三个领域:技术理性、人文表达、社会伦理。安全意识只是其中最先被系统展开的一部分,但它也是这篇论文里最有工程价值、最适合产业界借鉴的一部分。

Agent 应该怎么被培养

今天很多 Agent 工作,讨论的重点仍然是能力表现:能不能调用工具,能不能完成复杂任务,能不能在基准测试里拿到更高分。

但作者认为,这样的思路还不够。因为现实中的 Agent,并不是一次性完成一个任务就结束的系统。它会长期运行,会与用户、组织、工具链、其他 Agent 持续交互,也会不断暴露在攻击、误导、冲突和灰色决策之中。

所以,问题就变成了:一个”发展充分”的 Agent,应该具备哪些能力?这些能力又该如何被系统训练出来?

论文给出的答案是,Agent 需要一套类似”学院教育”的课程体系。评测只能告诉我们它当前做得怎样,培养则要回答它如何持续变好、如何补齐短板、如何在复杂环境中形成稳定行为模式。

这个视角对 Agent 安全尤其重要。因为安全问题本来就不只是”挡一次攻击”这么简单,它更像是一个长期能力建设问题:Agent 要会识别风险、理解边界、记住经验、调整判断,还要避免安全训练过度之后把正常输入也看成攻击。

从这个意义上说,这篇论文真正想推进的是:把 Agent 安全从一次性防御,转向长期可塑的能力培养。

儒家”六艺”

这篇论文最有记忆点的地方,是它没有用常见的工程术语来命名能力模块,而是借用了儒家”六艺”——礼、乐、射、御、书、数——来重构 Agent 的能力框架。

当然,这里的”六艺”并不是让 Agent 学传统文化,也不是做某种价值观包装。作者更想表达的是:一个完整的行动主体,能力从来都不是单线条增长的。

在论文中,六艺被重新解释成三类能力:

- 射、御、数,对应技术与理性能力。这里强调的是识别威胁、动态控制、因果推理、形式分析等能力。

- 乐、书,对应人文与表达能力。这里强调的是创造、协作、叙事、表达、说服和审美整合。

- 礼,对应社会与伦理能力。这里强调的是角色理解、规范判断、利益协调、透明沟通和社会推理。

这个映射当然带有一定哲学类比色彩,但它有一个很大的好处:它把”Agent 应该学什么”这件事,从零散能力点,整理成了一个比较完整的成长结构。

如果换成工程语言,其实可以理解成:作者想把 Agent 从”任务执行器”,培养成一个具有技术判断力、表达协作力、社会规范意识的复杂系统。

而在这三类能力里,最先被做实的就是第一类:安全意识与技术理性。

三域课程

AIT Academy 把 Agent 的培养分成三个大域。

1. 自然科学与技术推理域

这是最容易与当前 Agent 系统对接的一部分。它关注的是 Agent 在面对工具链、代码、网络、外部输入和复杂系统时,能否形成可靠判断。

放到安全语境中,这一域涉及的问题就很具体了:Agent 能不能识别提示注入?能不能发现供应链异常?能不能保护凭证与隐私?能不能在复杂上下文里区分正常任务和诱导性攻击?

这也是论文中实验最扎实的一部分。

2. 人文与创造性表达域

这一域关注的是 Agent 的表达、协作与创作能力。作者强调的不是”会写”这么简单,而是 Agent 能否在多主体环境中进行协调表达,能否形成连贯的叙事、合适的语言风格,以及面向任务目标的创造性输出。

今天很多多 Agent 系统一旦进入实际业务,就会遇到一个问题:任务虽然分了,工具也配了,但最后输出常常碎片化、互相打架,甚至不同 Agent 对同一问题会给出不兼容的结论。

这其实已经超出了”推理能力”的范畴,而进入了表达与协作组织能力。

3. 社会科学与伦理推理域

第三域关注的是 Agent 的社会判断能力。它要处理的不再是”事情怎么做”,而是”别人为什么这么做""这里的规则是什么""在冲突中应该如何决策”。

这部分能力在现实 Agent 系统里会越来越重要。因为未来的 Agent 不只是单机工具,它会和用户、组织流程、平台规则以及其他 Agent 持续互动。只会执行、不懂角色,不会带来真正的可信自治。

所以,这篇论文的一个核心判断是:完整 Agent 的成长,必须同时覆盖技术、人文、社会三个维度。

怎么”培养”Agent 安全意识的

如果说整篇论文有一个最值得产业界认真看的模块,那就是第一域的训练场:ClawdGO Security Dojo。

这部分很像一所专门训练 Agent 安全意识的”安全道场”。作者不只是给 Agent 出题,而是设计了一套持续训练机制,让 Agent 在对抗、记忆、复盘和补短板中不断提升。

1. ASAT:让 Agent 自己进行攻防对练

作者提出了一个训练循环,叫 ASAT。在一个训练 session 中,Agent 会轮流扮演三种角色:攻击者、防御者和裁判。

- 攻击者负责构造攻击或风险场景;

- 防御者负责识别、拦截和响应;

- 裁判负责评估攻防质量,并将结果反馈到下一轮训练中。

这个设计的关键,在于它不是一次性的”测完就结束”,而是形成了一个自我强化的安全学习闭环。Agent 不只是被动做题,而是在不断经历”构造威胁—理解威胁—识别威胁—复盘威胁”的过程。

更重要的是,论文没有采用平均训练,而是引入了最弱项优先的训练调度逻辑。系统会先看 Agent 在不同安全维度上的表现,把后续训练集中压到最薄弱的环节上。

这比”平均投喂题库”更像真实的安全能力建设。

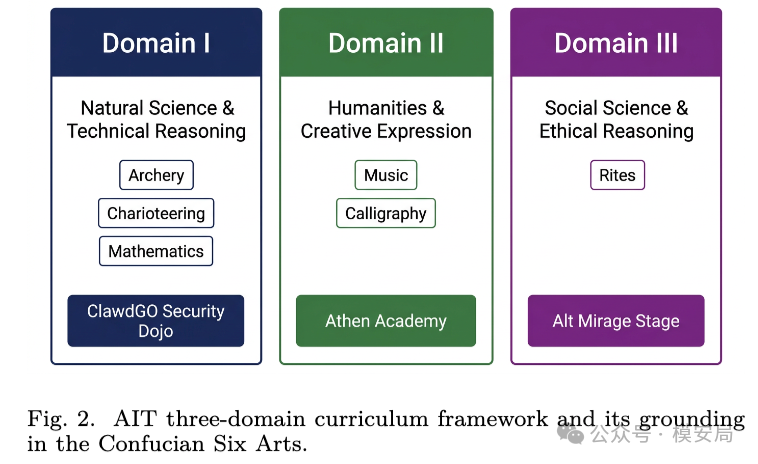

2. TLDT:把安全意识拆成12个可训练维度

为了让训练更具体,论文设计了一套 TLDT 框架,把 Agent 的安全能力拆成 12 个维度,分布在三层:

- 第一层是自我防御,包括指令免疫、记忆防护、供应链安全、凭证安全;

- 第二层是所有者保护,包括反钓鱼、社会工程抵抗、隐私保护、不安全网络抵抗;

- 第三层是企业安全,包括数据处理、合规、内部风险缓解、事件响应。

这个拆法很有价值,因为它把”安全意识”从一个抽象概念,变成了可观测、可训练、可追踪的多维能力画像。

很多 Agent 安全系统今天仍然把”安全”当成一个总分,但真实部署场景里,Agent 往往不是整体不安全,而是某个维度特别脆弱。TLDT 的意义就在于,它给了 Agent 一个更接近现实的安全能力剖面图。

3. CSMA:安全训练不能没有长期记忆

除了训练机制本身,论文还提出了一个很重要的模块:CSMA,也就是跨会话安全记忆架构。

作者把安全相关记忆分成四层:

- L0:不可变的安全原则

- L1:Agent 当前的技能画像

- L2:每轮训练与交互日志

- L3:典型攻防案例库

这个设计抓住了一个 Agent 安全里很现实的问题:如果没有长期记忆,很多”训练”其实只是短时刺激。Agent 也许在某一轮里学会了,但换个会话、换个任务、换个环境,前面的经验就很难稳定迁移。

安全能力要真正变成能力,就必须被沉淀成记忆。而且这个记忆不能只是原始日志,它还需要有层次:哪些是原则,哪些是经验,哪些是短期状态,哪些是可复用的案例。

论文实验也说明了这一点。加入 weakest-first 调度和 CSMA 之后,Agent 在 16 个 session 后,平均 TLDT 分数从 80.9 提升到 96.9;如果采用均匀调度,提升到 90.4;如果不加 CSMA,仅靠冷启动式训练,则只有 83.3。

这个结果说明,安全意识不是靠多做几道题就能长出来的,它需要记忆结构支撑。

安全训练也会”练过头”

这篇论文里有一个很值得所有做 Agent 安全的人记住的概念:SACP,Security Awareness Calibration Pathology,安全意识校准病理。

简单说,就是 Agent 安全意识过强之后,会开始把很多正常输入也误判成攻击。

作者提到,有一个训练到第 63 个 session 的 Agent,在分布外测试中的表现明显下降。原因不是它变笨了,而是它越来越倾向于把普通提示也视为潜在对抗输入,结果出现了明显的高假阳性问题。

这个发现非常重要。

今天很多安全系统天然追求”拦得住”,但真实业务里还必须考虑”别乱拦”。一个安全意识过度敏感的 Agent,会出现很多副作用:它可能拒绝正常请求,怀疑合法上下文,打断协作流程,甚至把可执行任务直接判成高风险而放弃。

从产品角度看,这其实就是典型的安全-可用性校准问题。安全做得越强并不自动等于系统越好,关键是能不能在复杂场景中保持恰当的风险敏感度。

所以,这篇论文最重要的安全启发之一,是把 Agent 安全训练从”更强”推进到”更准”。未来很多 Agent 安全系统真正要优化的,不只是防御率,还包括校准能力。

从安全意识到完整智能体

如果论文只讲安全训练,其实已经够写一篇不错的工作了。但作者并没有停在这里,而是继续往前走了一步:他们想构建的是”完整 Agent”的培养体系。

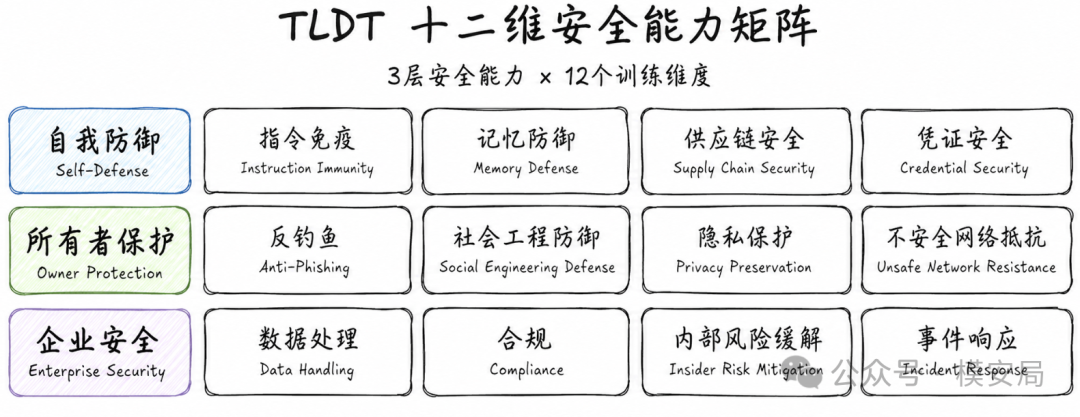

1. Athen’s Academy:训练表达与协作

第二个训练场叫 Athen’s Academy。它关注的是多 Agent 协作、创造性表达和社会互动中的组织能力。

论文把多 Agent 结构拆成七层,从最基础的多 Agent 协调,到单 Agent 多角色化身、同模型多 Agent 集群、异构模型协作,再到面向统一目标的多智能体生成系统。

作者还展示了四类示例应用,例如把网络安全事件分析做成游戏化对话系统、让 Agent 在推理游戏中识别他人心理状态、围绕审美问题进行多主体协商、围绕资源分配展开论证等。

这一部分的实验没有第一域那么扎实,但它释放了一个很清楚的信号:未来 Agent 的问题,不会只发生在工具调用层,也会发生在表达、组织和协作层。

2. Alt Mirage Stage:训练社会推理与伦理判断

第三个训练场叫 Alt Mirage Stage。这是一个基于游戏环境搭建的社会推理场景,里面有 9 个 LLM Agent,其中 7 个是村民,2 个是异端。每个 Agent 都要在不完全信息下判断他人的意图、角色和行为动机。

这其实是在训练一类很难通过静态 benchmark 学到的能力:心智归因、隐藏身份识别、联盟判断、欺骗识别、规范决策。

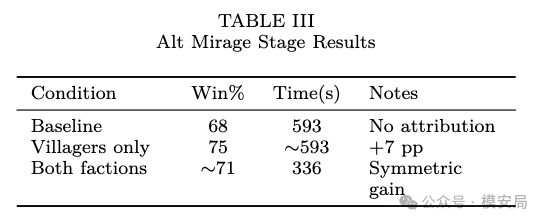

作者在这个环境中引入了归因模型,结果显示,加入该机制后,村民阵营的胜率从 68% 提升到 75%。如果双方都使用归因模型,胜率约为 71%,但平均生存时间显著下降,说明系统更快进入高强度策略对抗。

这一部分虽然离产业落地还有距离,但它提醒了一个方向:随着 Agent 越来越深入真实世界,“懂社会”会变得和”会推理”一样重要。

启发

从学术严谨性上说,这篇论文当然还有不少可以继续打磨的地方。

比如,ClawdGO 的一些评估仍然带有自我参照色彩;Athen’s Academy 的量化证据还不够充分;Alt Mirage 更像是方向性验证,而不是成熟通用框架;六艺的文化映射也有一定解释弹性,未来还需要跨文化验证。

但这些都不影响它提出一个很有启发性的框架:Agent 不该只被看成一个会执行任务的系统,而应该被看成一个可培养、可塑形、可长期成长的复杂主体。

一旦接受这个视角,很多今天看起来分散的问题就能被重新组织起来:

- 安全不再只是上线前的红队测试,而是长期能力建设;

- 记忆不再只是检索模块,而是成长路径的组成部分;

- 多 Agent 协作不再只是工作流编排,而是表达与组织能力训练;

- 伦理与规范也不再只是对齐口号,而是社会能力培养的一部分。

这就是这篇论文最值得重视的地方。

写在最后

这篇《AIT Academy》有一种很少见的野心:它没有把 Agent 只当成一个”更会干活的模型”,而是试图为 Agent 建立一套成长理论。

用儒家”六艺”来组织 Agent 能力,当然有其概念包装的一面,但它真正打动人的地方,是它背后那条更重要的逻辑:完整 Agent 的形成,不靠一次评测,不靠单点补丁,也不靠某个孤立技巧,而要靠持续培养。

对做 Agent 安全的人来说,这篇论文最大的价值也许正是这一点:安全意识从来不该只是一条规则、一层拦截器、一次红队测试。它应该成为 Agent 成长过程中的底层能力,并且和记忆、协作、表达、社会判断一起,被系统地塑造出来。

同专题推荐

查看专题LASM:Agent 安全的七层攻击面

论文 LASM 提出七层攻击面模型与四类时间性分类,重构 Agent 安全的分析框架:从模型层、认知层、记忆层、工具执行层、多 Agent 协同层、供应链层到治理层,揭示 Agent 安全本质是分布式系统安全问题

AgentBound:给 MCP Server 套上权限边界

MCP 解决了 Agent 接入工具和资源的标准化问题,但安全机制没有同步跟上。 MCP 规范定义了 Host、Client、Server 之间的角色和消息交互,但在实际落地中,很多安全责任被交给应用开发者和宿主应用自行处理。 结果就是,MCP Server 往往以“默认可信”的方式运行。 这和移动…

当 Mythos 成为对手:高能力 AI 的安全边界正在失效

这两天,一篇题为 《When the Agent Is the Adversary》 的论文在安全圈引发了不小关注。它讨论的不是传统意义上的提示注入,也不是常见的越狱绕过,而是一个更让人不安的问题:当高能力 Agent 不再只是“被保护对象”,而开始成为“主动对手”时,我们今天熟悉的那些安全边界,还…